Kunstig intelligens og maskinlæring i cybersikkerhed

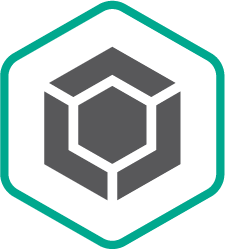

Pioneren inden for kunstig intelligens, Arthur Samuel, beskrev kunstig intelligens som et sæt metoder og teknologier, der ”giver computere mulighed for at lære uden at være specifikt programmeret”. I et konkret tilfælde med overvåget læring i bekæmpelse af malware kan opgaven formuleres således: Givet et sæt objektfunktioner \( X \) og tilsvarende objektetiketter \( Y \) som input kan der skabes en model, som vil producere de korrekte etiketter \( Y' \) til hidtil usete testobjekter \( X' \). \( X \) kunne være nogle funktioner, der repræsenterer filindhold eller adfærd (filstatistik, liste over anvendte API-funktioner osv.), og etiketter \( Y \) kunne helt enkelt være “malware” eller ”godartet” (i mere komplekse tilfælde vil vi være interesseret i en finkornet klassificering, f.eks. Virus, Trojan-Downloader, Adware osv.). I tilfælde af uovervåget læring er vi mere interesserede i at afsløre skjult datastruktur – f.eks. at finde grupper af lignende objekter eller stærkt korrelerede funktioner.

Kasperskys næste generation af beskyttelse i flere lag udnytter AI-tilgange, f.eks. maskinlæringsmetoder (ML), i vid udstrækning på alle stadier i detektionsfasen – lige fra skalerbare klyngemetoder, der bruges til forbehandling af indgående filstrømme til robuste og kompakte, dybe neurale netværksmodeller til adfærdsdetektion, der fungerer direkte på brugernes maskiner. Disse teknologier er designet til at håndtere adskillige vigtige krav til cybersikkerhedsprogrammer i den virkelige verden, herunder et ekstremt lavt antal falske positiver, fortolkning af modeller og robusthed mod fjender.

Lad os gennemgå nogle af de vigtigste maskinlæringsbaserede teknologier, der anvendes i Kasperskys slutpunktsprodukter:

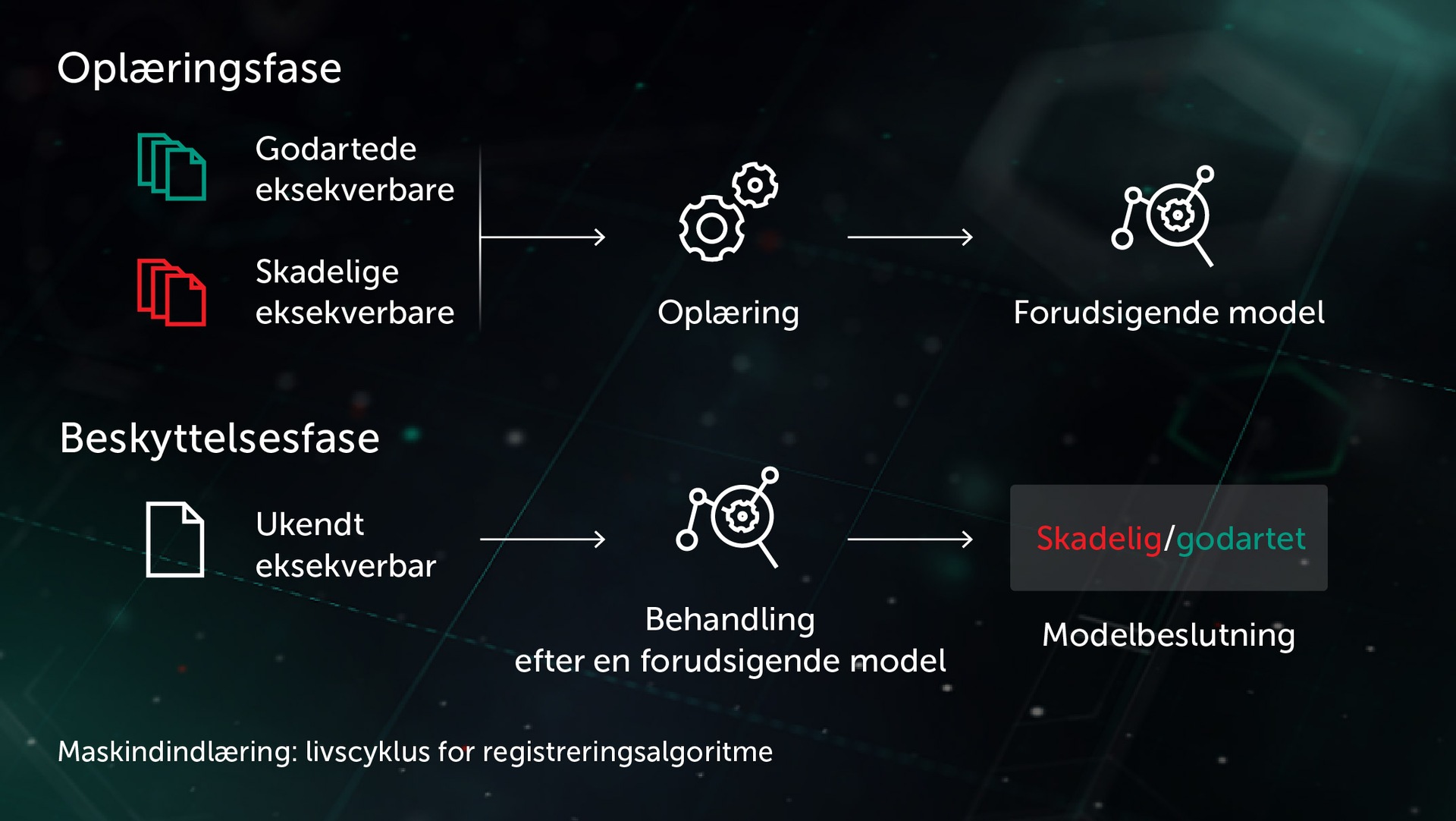

Ensemble af beslutningstræer

I denne fremgangsmåde udgør den prædiktive model et sæt beslutningstræer (f.eks. tilfældig skov eller gradientforstærkede træer). Hver node uden underelement i træstrukturen indeholder et spørgsmål vedrørende funktioner i en fil, mens noder med underelementer indeholder den endelige afgørelse om træet på objektet. Under testfasen gennemgår modellen træet ved at besvare spørgsmålene i noderne med de tilsvarende funktioner i det pågældende objekt. I sidste fase beregnes beslutninger af flere træer i gennemsnit på en algoritmespecifik måde for at give endelig beslutning om objektet.

Modellen gavner den proaktive beskyttelse før eksekveringen på slutpunktstedet. Et af vores programmer, som gør brug af denne teknologi, er Cloud ML til Android, der bruges til detektion af mobiltrusler.

Lighedshashing (lokalitetsfølsom hashing)

Før i tiden var hashes, der blev brugt til at afsætte ”malware-fodspor”, følsomme over for enhver lille ændring i en fil. Denne ulempe blev udnyttet af malwareforfattere gennem forvirringsteknikker såsom polymorfisme på serveren: mindre ændringer i malware gjorde den mulig at skjule. Lighedshash (eller lokalitetsfølsom hash) er en AI-metode til at detektere lignende ondsindede filer. For at gøre dette udtrækker systemet filfunktioner og bruger ortogonal projektionslæring til at udvælge de vigtigste funktioner. Maskinlæringsbaseret kompression anvendes derefter således, at værdivektorer fra lignende egenskaber omdannes til lignende eller identiske mønstre. Denne metode leverer en god generalisering og reducerer størrelsen af detektionsposternes base mærkbart, da en post nu kan detektere hele familien af polymorf malware.

Modellen gavner den proaktive beskyttelse før eksekveringen på slutpunktstedet. Den anvendes i vores Similarity Hash Detection System.

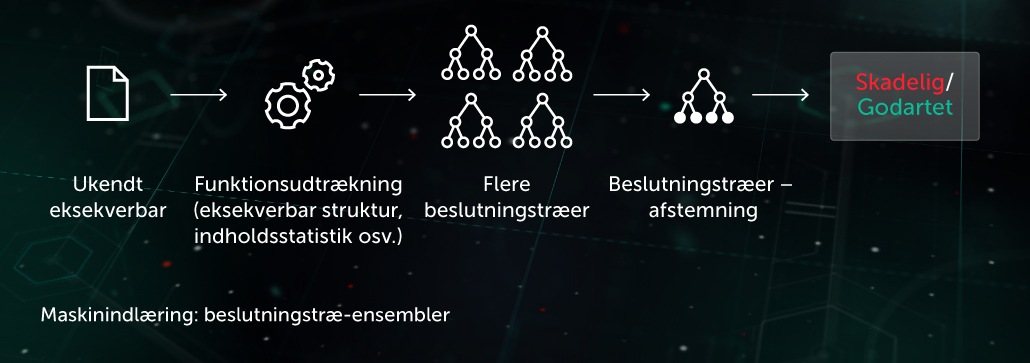

Adfærdsmodel

En overvågningskomponent tilvejebringer en adfærdslog, hvor sekvensen af systemhændelser opstod under procesudførelsen sammen med tilsvarende argumenter. For at opdage ondsindet aktivitet i observerede logdata komprimerer vores model sekvensen af hændelser til et sæt binære vektorer og træner det dybe neurale netværk til at kunne skelne godartede fra ondsindede logfiler.

Objektklassifikationen foretaget af adfærdsmodellen bruges af både statiske og dynamiske detektionsmoduler i Kaspersky-produkter på slutpunktssiden.

AI spiller også en lige så vigtig rolle i opbygningen af infrastruktur i laboratorier til behandling af malware. Kaspersky bruger det til følgende infrastrukturformål:

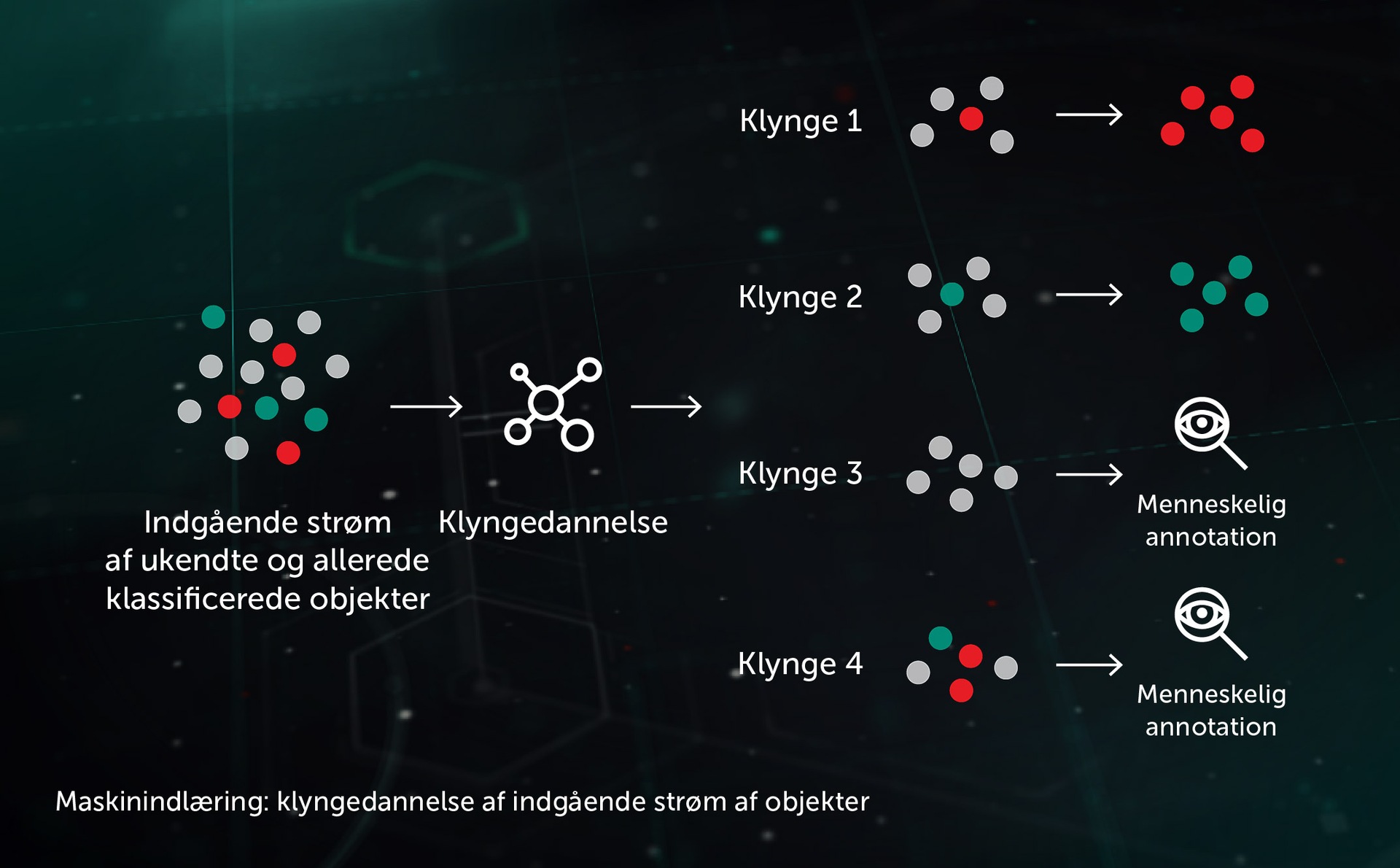

Indgående streamklynger

Maskinlæringsbaserede klyngealgoritmer giver os mulighed for effektivt at adskille de store mængder af ukendte filer, der ankommer til vores infrastruktur, i et rimeligt antal klynger, hvoraf nogle automatisk kan behandles baseret på tilstedeværelsen af et allerede kommenteret objekt.

Klassifikationsmodeller i stor skala

Nogle af de mest kraftfulde klassifikationsmodeller (såsom en meget stor tilfældig beslutningsskov) kræver betydelige ressourcer (processortid, hukommelse) samt omkostningstunge funktionsudtræk (f.eks. kan behandling via sandkasse være påkrævet for detaljerede adfærdslogfiler). Det er derfor mere effektivt at beholde og køre modellerne i et laboratorium og derefter destillere den viden, som sådanne modeller har udvundet ved at træne nogle letvægtsklassifikationsmodeller ud fra outputbeslutninger for den større model.

Sikkerhed i forbindelse med maskinlæring

Maskinlæringsalgoritmer kan, når de er frigivet fra laboratoriets rammer til den virkelige verden, være sårbare over for mange former for angreb, der er designet til at tvinge AI-systemer til at lave bevidste fejl. En angriber kan forgifte et træningsdatasæt eller foretage Reverse Engineering af modellens kode. Desuden kan hackere ‘brute-force’ ML-modeller med hjælp fra særligt udviklede ‘adversarial AI’-systemer – som automatisk kan generere mange angrebseksempler og aktivere dem mod den beskyttende løsning eller den udtrukne ML-model , indtil et svagt punkt i modellen opdages. Virkningen af sådanne angreb på antimalwaresystemer, som bruger AI, kan være ødelæggende: en forkert identificeret trojaner betyder, at millioner af enheder bliver inficeret, og at millioner af dollars går tabt.

Af denne grund er der nogle vigtige overvejelser, der skal gøres ved brug af AI i sikkerhedssystemer:

- Sikkerhedsleverandøren bør forstå og omhyggeligt håndtere væsentlige krav til AI-elementers ydeevne i den virkelige, potentielt fjendtlige verden, dvs. krav, der omfatter robusthed over for potentielle fjender. ML/AI-specifikke sikkerhedsrevisioner og ‘red-teaming’ bør være vigtige elementer i udviklingen af sikkerhedssystemer, der bruger AI-aspekter.

- Ved vurdering af en løsnings sikkerhed, der bruger AI-elementer, skal du spørge, i hvilken grad løsningen afhænger af tredjepartsdata og arkitekturer, da mange angreb er baseret på tredjepartsinput (vi taler om trusselefterretningsfeeds, offentlige datasæt, forhåndstrænede og outsourcede AI-modeller).

- ML/AI-metoder bør ikke betragtes som en tryllestav. De skal indgå i en sikkerhedstilgang i flere lag, hvor supplerende beskyttelsesteknologier og menneskelig ekspertise arbejder sammen og har hinandens rygge.

Det er vigtigt at anerkende, at selv om Kaspersky har omfattende erfaring inden for effektiv brug af AI-aspekter, f.eks. ML og Dyb Lærings-undersæt i sine cybersikkerhedsløsninger, er disse teknologier ikke ægte AI, eller Kunstig Generel Intelligens (AGI). Der er stadig lang vej, før maskiner kan arbejde selvstændigt og udføre de fleste opgaver helt uafhængigt. Indtil da vil næsten alle aspekter af AI i cybersikkerhed kræve vejledning og ekspertise fra fagfolk til at udvikle og forfine systemerne og udvikle deres kapaciteter med tiden.

For en mere detaljeret oversigt over populære angreb påML/AI-algoritmer og metoderne til beskyttelse mod disse trusler kan du se vores hvidbog ”AI under Attack: How to Secure Artificial Intelligence in Security System” (AI under angreb: Sådan sikrer du kunstig intelligens i sikkerhedssystemer).

Relaterede produkter

Relaterede teknologier

Whitepaper

Whitepaper

Whitepaper

WhitepaperMachine Learning for Malware Detection

Whitepaper

Whitepaper

Whitepaper

WhitepaperMachine learning and Human Expertise

Whitepaper

Whitepaper

Whitepaper

WhitepaperAI under Attack: How to Secure Machine Learning in Security System